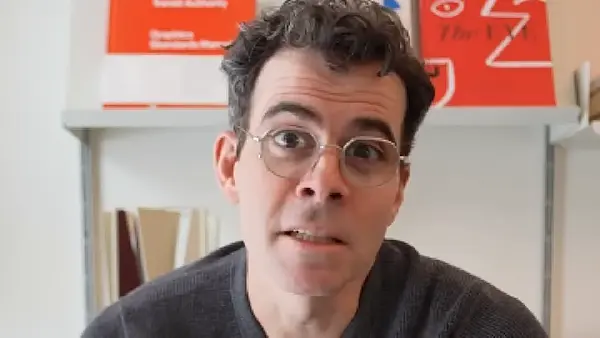

Adam Mosseri: nem az AI-t kell felismerni, hanem a valódi tartalmat

Írta: Ostroml

Adam Mosseri, az Instagram vezetője a közösségi médiában terjedő mesterséges intelligencia által generált tartalmak kapcsán fogalmazta meg markáns álláspontját. Szerinte az AI-val készült képek, videók és egyéb tartalmak mennyisége rohamosan nő, és hamarosan több ilyen anyag kerül fel a platformokra, mint hagyományos módon létrehozott tartalom. Ebben a környezetben Mosseri úgy látja, nem az AI felismerése lesz a kulcskérdés, hanem az, hogy hogyan tudjuk hitelesen azonosítani a valódi médiatartalmakat.

A közösségi oldalakra egyre nagyobb nyomás nehezedik, hogy megjelöljék az AI által generált tartalmakat, ám Mosseri szerint ez hosszú távon zsákutca lehet. A technológia fejlődésével egyre nehezebb lesz megkülönböztetni a mesterséges és a valós anyagokat, különösen akkor, amikor az AI már fotórealisztikus minőségben képes tartalmat előállítani. Éppen ezért egy másik irányt javasol: a valódi média „ujjlenyomatának” létrehozását.

Ez a gyakorlatban azt jelentené, hogy a kameragyártók már a rögzítés pillanatában digitálisan aláírnák a képeket és videókat, hitelesítve azok eredetét. Egy ilyen rendszer nem az AI-t próbálná leleplezni, hanem pozitív módon jelölné meg azt, ami bizonyíthatóan emberi alkotás. Mosseri szerint ez hatékonyabb és fenntarthatóbb megoldás lehet egy olyan világban, ahol az AI-tartalom alapértelmezetté válik.

Bár a digitális vízjelek és jelölések segíthetnek, a probléma ennél mélyebb. Az AI-val készült tartalmak mennyisége már most is óriási, és több platform AI-címkézési rendszere sem működik hibátlanul. A felismerés pontossága folyamatos kihívást jelent, és ez a nehézség csak fokozódik a technológia fejlődésével.

A kérdés tehát nyitott: a humán tartalmak hitelesítése lehet-e a megoldás, vagy a technológiai vállalatoknak kell nagyobb felelősséget vállalniuk a tartalmak eredetének kezelésében? Egy biztos: az AI és a közösségi média kapcsolata az elkövetkező évek egyik legfontosabb vitatémája lesz, és alapjaiban formálhatja át azt, ahogyan az online tartalmakban megbízunk.

HOZZÁSZÓLÁSOK

A hozzászóláshoz be kell jelentkezned.

LoginOLVASD EL EZEKET IS: